人工智能如何重塑网络与信息安全软件开发 机遇、挑战与未来

在数字化浪潮席卷全球的今天,网络安全已成为国家安全、经济发展和社会稳定的基石。随着网络攻击手段日益复杂化、自动化,传统的基于规则和签名的防御体系显得力不从心。人工智能的崛起,正以前所未有的深度和广度,重塑着网络与信息安全软件开发的格局,带来了革命性的机遇,也伴随着不容忽视的挑战。

一、机遇:AI驱动的主动智能防御

AI技术,特别是机器学习和深度学习,为信息安全软件开发注入了“智能”与“主动”的新基因。

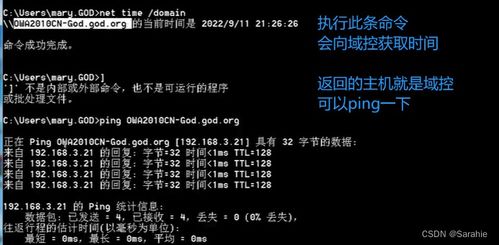

- 威胁检测与响应(TDR)的革新: 传统安全软件依赖于已知攻击特征库(签名),对零日漏洞和新型高级持续性威胁(APT)反应滞后。AI模型能够分析海量网络流量、日志和终端行为数据,学习“正常”行为基线,从而异常精准地识别出偏离基线的可疑活动,实现近乎实时的威胁发现。例如,通过用户和实体行为分析(UEBA),AI可以识别账号的异常登录地点、时间或数据访问模式,提前预警内部威胁或凭证窃取攻击。

- 漏洞管理与预测性安全: 开发安全的软件需要管理海量的代码漏洞。AI可以辅助进行自动化代码审计,通过模式识别快速定位潜在的安全漏洞(如SQL注入、缓冲区溢出点),提升开发效率。更进一步,结合大数据分析,AI可以预测哪些系统组件最可能被攻击者利用,帮助安全团队优先修补关键漏洞,实现从“被动修补”到“主动加固”的转变。

- 安全运营中心(SOC)的智能化: 安全分析师日常面临海量告警,极易产生疲劳和误判。AI驱动的安全编排、自动化与响应(SOAR)平台,能够自动关联、筛选和分类安全事件,甚至执行预设的响应剧本(如隔离受感染主机、阻断恶意IP),大幅减轻人工负担,提升事件响应速度与准确性。

- 自适应认证与反欺诈: 在身份安全领域,AI通过分析用户的多维度行为特征(如打字节奏、鼠标移动、常用设备等),实现动态、隐式的持续身份认证,在提升安全性的同时优化用户体验。在金融等领域,AI模型能更有效地识别复杂的交易欺诈模式。

二、挑战:双刃剑的另一面

AI在赋能安全的其自身也带来了新的风险维度,对软件开发提出了更高要求。

- 对抗性AI攻击: 攻击者同样可以利用AI。他们可以创建“对抗性样本”来欺骗AI检测模型,例如,微调恶意软件代码使其绕过AI杀毒引擎的检测;或使用生成式AI(如大型语言模型)制造高度逼真的钓鱼邮件和虚假信息(深度伪造),进行社会工程学攻击。这要求安全软件必须具备对抗此类“AI对抗攻击”的韧性。

- 数据隐私与算法偏见: AI模型的训练需要大量数据,其中可能包含敏感信息。如何在利用数据提升安全能力与保护用户隐私之间取得平衡,是开发中的核心伦理与法律难题。如果训练数据存在偏差,AI模型可能会产生歧视性判断,例如错误地将特定地域或群体的正常行为标记为异常。

- 模型可解释性与信任危机: 许多先进的AI模型(尤其是深度学习)如同“黑箱”,其决策过程难以解释。当AI系统误封账号或误报攻击时,开发者和用户难以追溯原因,这影响了系统的可信度和责任界定。开发可解释的AI(XAI)已成为安全软件领域的重要研究方向。

- 技术门槛与资源需求: 集成AI能力需要开发团队具备数据科学、机器学习等交叉学科知识,模型训练和推理需要强大的算力支持,这提高了安全软件的开发与部署成本。

三、未来方向:走向人机协同的智能安全生态

网络与信息安全软件的将是深度集成AI的人机协同智能系统。

- 增强智能(Augmented Intelligence): 强调AI作为分析师的“增强”工具,而非完全替代。AI负责处理海量、重复性工作并给出建议,人类专家则专注于战略决策、复杂关联分析和应对新型威胁的创造力。软件设计需更加注重人性化的人机交互界面。

- 隐私计算与联邦学习: 为解决数据隐私问题,未来的安全软件将更多采用联邦学习、差分隐私等技术。模型可以在数据不出本地的情况下进行协同训练,既汇聚群体智慧,又保障个体数据安全。

- AI安全自身成为标配: “AI安全”模块将成为下一代安全软件的必备组件。这包括对AI模型自身的防护(防对抗攻击)、对其决策的审计与解释,以及确保其应用符合伦理规范。

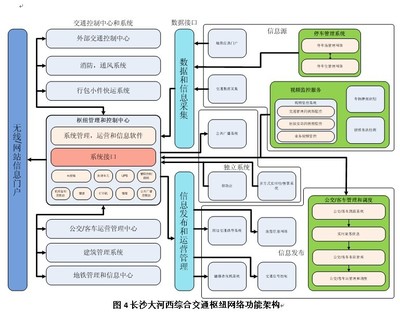

- 标准化与协同防御: 行业需要推动AI在网络安全应用中的标准、框架和最佳实践,促进不同安全产品之间AI威胁情报的共享与联动,构建全局性的智能协同防御网络。

###

人工智能正在将网络与信息安全软件开发从“静态规则”时代推向“动态智能”时代。它极大地提升了我们感知、预测和响应威胁的能力,但同时也引入了新的攻击面和治理难题。对于开发者而言,关键在于以辩证的思维,在积极拥抱AI赋能的必须将AI自身的安全性、可解释性、公平性和隐私保护内置于软件开发生命周期的每一个环节。只有这样,我们才能驾驭这把锋利的双刃剑,构筑起真正稳固、可信的智能网络安全防线。

如若转载,请注明出处:http://www.wtmic.com/product/63.html

更新时间:2026-06-02 06:02:37